随着人工智能技术的飞速发展,大模型(Large Language Models, LLMs)已成为技术领域最受关注的方向之一。对于初入行的程序员或技术爱好者而言,理解大模型的技术脉络与应用体系,是把握未来技术趋势的关键一步。本文旨在系统梳理大模型的核心技术、应用场景与学习路径,为“技术小白”提供一份清晰的入门地图。

一、 大模型技术核心:从基础到前沿

大模型通常指参数规模巨大(数十亿至数万亿)、经过海量数据训练的自然语言处理模型。其技术栈可概括为以下几个层次:

- 基础架构层:

- Transformer架构:这是几乎所有现代大模型的基石。其核心是自注意力(Self-Attention)机制,能够高效处理序列数据,并捕捉长距离依赖关系。理解Transformer的编码器-解码器结构、多头注意力等概念是入门第一步。

- 预训练范式:大模型通常采用“预训练+微调”两阶段范式。预训练阶段,模型在无标注的通用海量文本上学习语言的内在规律(如GPT系列的自回归语言建模,BERT系列的掩码语言建模)。微调阶段,则使用特定领域的有标注数据对模型进行针对性优化。

- 模型演进与家族:

- 编码器系(如BERT):擅长文本理解任务,如分类、实体识别。其预训练目标是通过上下文预测被遮蔽的词汇。

- 解码器系(如GPT系列):擅长文本生成任务,根据上文逐词生成下文。ChatGPT、GPT-4等均属此列,其核心能力是“对话”与“创作”。

- 多模态模型:当前前沿方向,如CLIP(图文匹配)、DALL-E(文生图)、GPT-4V(视觉理解)等,能够理解和生成跨越文本、图像、音频等多种模态的内容。

- 关键使能技术:

- 缩放定律(Scaling Laws):揭示了模型性能随参数规模、数据量和计算量增加而可预测提升的规律,是大模型“变大”的理论依据。

- 对齐技术(Alignment):如何让大模型的输出符合人类价值观和意图?这依赖于基于人类反馈的强化学习(RLHF)等技术,是ChatGPT等产品体验友好的关键。

- 推理优化与部署:如何让大模型高效、低成本地运行?涉及模型量化、剪枝、蒸馏、专用推理框架(如vLLM, TensorRT-LLM)等技术。

二、 大模型应用体系:从场景到实践

大模型并非空中楼阁,其价值在于落地应用。其应用体系可划分为以下几个层面:

- 通用能力直接调用:

- AIGC(人工智能生成内容):文案写作、代码生成、翻译、摘要、创意写作等。

- 智能问答与对话:智能客服、个性化助手、知识问答系统。

- 内容分析与洞察:情感分析、舆情监控、文档信息抽取与结构化。

- 垂直行业深度融合:

- 金融:智能投研报告生成、风险报告审核、合规审查。

- 教育:个性化学习伴侣、智能批改、课件生成。

- 医疗:辅助诊断报告生成、医学文献摘要、患者咨询预诊。

- 编程开发:Copilot类代码辅助工具、自动化测试用例生成、代码注释与解释。

- 办公与娱乐:会议纪要生成、PPT大纲制作、游戏剧情与对话生成。

- 应用开发新模式:

- 提示工程(Prompt Engineering):通过精心设计输入提示(Prompt),引导大模型完成复杂任务,是当前最主要的应用开发方式。

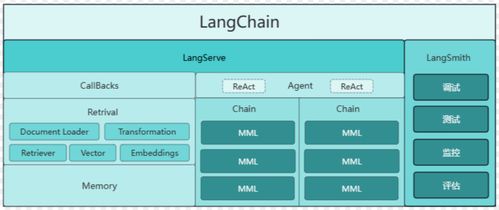

- AI Agent(智能体):让大模型具备使用工具(搜索、计算、执行代码)、制定计划、自主执行任务的能力,是迈向更通用人工智能的关键形态。

- 模型微调(Fine-tuning):使用自有数据对基础大模型进行额外训练,使其更贴合特定业务需求,获得私有化、专业化的模型能力。

三、 小白程序员学习路径建议

- 第一步:建立认知与体验

- 广泛阅读科普文章、技术综述,建立宏观认知。

- 亲身体验ChatGPT、文心一言、通义千问、Claude等主流产品,直观感受其能力与边界。

- 关注国内外领先机构(OpenAI, Anthropic, 国内各大厂)的动态与技术报告。

- 第二步:夯实理论基础

- 机器学习基础:理解监督学习、无监督学习的基本概念。

- 深度学习入门:掌握神经网络、反向传播、梯度下降等核心知识。

- 自然语言处理基础:了解词向量、RNN/LSTM等经典模型,然后重点钻研Transformer架构(推荐阅读经典论文《Attention Is All You Need》)。

- 第三步:动手实践与开发

- 学习框架与工具:熟悉PyTorch或TensorFlow深度学习框架。学习Hugging Face Transformers库,这是接触和调用开源大模型的最重要平台。

- 从API调用开始:尝试使用OpenAI、百度、智谱等提供的API,完成一个简单的文本生成或对话应用。

- 跑通开源模型:在本地或云端环境,尝试加载和运行较小的开源模型(如Llama 2-7B, ChatGLM3-6B, Qwen-7B),进行推理和简单的对话。

- 深入提示工程与微调:学习Prompt设计技巧,并尝试使用LoRA等高效微调技术,在特定数据集上微调一个开源模型。

- 第四步:跟踪前沿与深入专项

- 持续关注顶级会议(NeurIPS, ICLR, ACL等)的最新论文。

- 根据兴趣选择深入方向,如多模态模型、AI Agent架构、模型压缩与加速、大模型安全与对齐等。

###

大模型技术正以前所未有的速度重塑软件开发和知识工作的范式。对于程序员而言,它既是强大的生产力工具,也是充满机遇的新赛道。入门之路虽涉及广泛,但遵循“建立认知-夯实基础-动手实践-持续深入”的路径,逐步构建起自己的知识体系,便能从“小白”稳步成长为能够驾驭这一技术的开发者。记住,最好的学习方式是立即开始,从阅读一行代码、运行一个Demo、完成一个小项目做起。